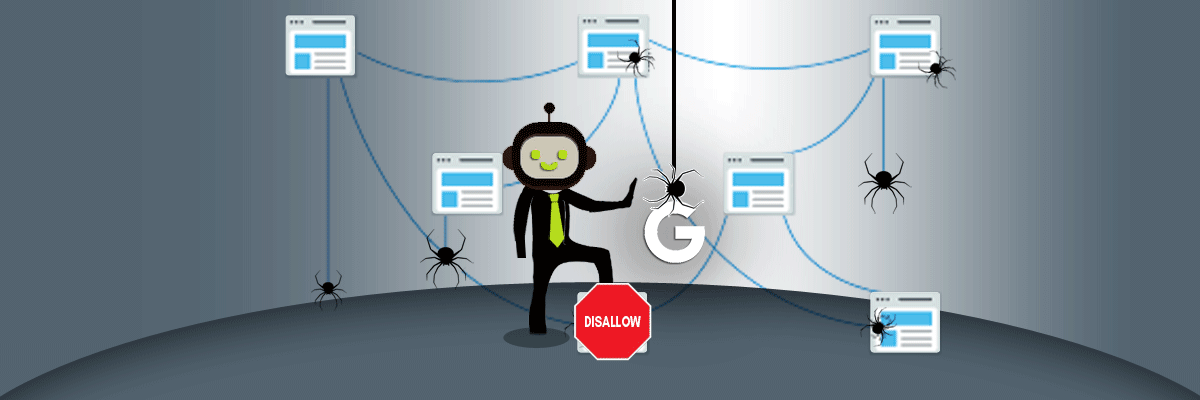

De qué hablamos cuando hablamos de robots.txt. Cuando hablamos de SEO, hablamos de indexación. Que Google nos indexe es el objetivo principal de cualquier acción de SEO y controlar lo que Google indexa, es primordial para controlar la salud del sitio web. El archivo robots.txt es ese archivo del que no siempre nos acordamos, pero que permite controlar el rastreo de nuestra web por parte de los motores de búsqueda.

Esto, puede favorecer positivamente la visibilidad de nuestra web en los buscadores. Gracias a las directrices que damos a los motores de búsqueda tanto en este archivo, como en las etiquetas para robots de las que hablaremos más adelante, logramos que Google rastree únicamente el contenido que es más susceptible de posicionar. Hacemos que Google invierta el presupuesto de rastreo que nos otorga en los contenidos más relevantes para nuestra estrategia SEO.

Vayamos paso a paso y conozcamos a este gran aliado del posicionamiento.

Contenidos

¿Qué son los archivos robots.txt?

Cuando creamos un sitio web, necesitamos que Google rastree las páginas que lo componen para que, tras ese rastreo inicial, pueda añadir la información descubierta a su índice. Para dar esta orden, es necesario crear un archivo de texto (en formato .txt) en nuestro dominio con el objetivo de dar al buscador (a partir de ahora, Google) directrices que le permitan llegar a la información que consideramos relevante en nuestro sitio web.

Hay que tener en cuenta que, este archivo, no sirve para declarar qué información es necesaria y queremos que Google encuentre. Nos sirve para declarar que información NO queremos que Google rastree e indexe.

Veamos puntos importantes acerca de la indexación y el archivo robots.txt.

¿Qué es la indexación?

En anteriores entradas de nuestro blog explicamos qué es la indexación y la desindexación así como los motivos por los que desindexar de Google. Vamos a refrescar un poco la memoria…

La indexación es el proceso de rastreo y archivado que hacen los bots de los buscadores de todo el contenido de internet con una URL susceptible de ser indexada (es decir, que no tenga un bloqueo a través del archivo robots.txt, un error que impida mostrar el contenido, una canonicalización o una redirección que impida acceder al mismo). Cuando se ha realizado el rastreo, los buscadores, como Google, proceden a crear índices en base a la captación del rastreo. Los buscadores incluyen en sus índices las URL indexadas que ha logrado rastrear.

La indexación tiene más miga que lo que acabamos de explicar a grandes rasgos. Te invitamos a que eches un vistazo a nuestra entrada de blog “Indexar o desindexar, he ahí la cuestión” para conocer de forma más amplia todo lo referente a este concepto.

Además, dado el habitual uso de dispositivos móviles hoy en día, te dejamos también un escrito sobre “La indexación centrada en móviles”.

¿Dónde se encuentra el archivo robots.txt?

El archivo robots.txt se encuentra en la carpeta raíz de un sitio web; es decir, en el primer nivel de archivos de la carpeta del servidor a la que apunta el dominio. Esta carpeta raíz es la contenedora de todos los archivos y carpetas de la web que conforman un sitio web. Para acceder al archivo robots.txt, tenemos que tener acceso al servidor del dominio mediante FTP o un sistema de gestión de archivos a través de un panel de control como CPanel o Plesk.

Es muy importante aclarar que únicamente una persona experta en la materia debería de tocar esta carpeta. Un cambio inoportuno podría hacer que el sitio web deje de estar disponible.

¿Qué pasa si no hay robots.txt?

Partimos de la premisa de que la existencia de un archivo robots.txt no es necesario en una web, pero sí recomendable. Con la inexistencia de este archivo, Google encuentra la web y comienza a rastrear a través de los enlaces todo el contenido sin control. Sin el robots.txt, tendrá acceso a todos los directorios y archivos presentes en el servidor al que apunta el dominio.

Cuando no hay fichero robots.txt, Google accederá continuamente a cada una de las partes o directorios de nuestro dominio y analizará si ha habido algún tipo de cambio. Y, ¿esto es negativo? En este punto es importante hablar del presupuesto de rastreo que asigna Google a cada sitio web.

Presupuesto de rastreo o Crawl Budget

El presupuesto de rastreo o Crawl Budget podría resumirse como la cantidad de páginas que Google rastrea en un sitio web, durante un periodo determinado. No podemos perder de vista que Google rastrea siguiendo enlaces, esto hace que cualquier error que pueda encontrarse o cualquier contenido de poco valor, también denominado thin content, le retrasará haciendo que la cantidad de páginas con contenido de calidad que puede rastrear en ese periodo de tiempo, se reduzca.

Bien. Pero, ¿por qué hablamos del presupuesto de rastreo? Este presupuesto se va “consumiendo” a medida que Google va rastreando nuestra web. Como hemos mencionado, si no tenemos configurado un archivo robots.txt, el rastreo se llevará a cabo de forma masiva en todas las carpetas y archivos que cuelgan de la carpeta raíz del dominio, que es donde está alojada toda la información. Si por el contrario, ponemos bloqueadores a través del archivo robots.txt, guiaremos a Google marcando el camino de qué queremos y qué no queremos que rastree. De esta forma, controlamos que el presupuesto de rastreo no se divague por archivos que no son necesarios que Google descubra.

Con todo ello, si no tenemos un archivo robots.txt que delimite qué queremos y qué no queremos que Google descubra, el presupuesto será quien determine hasta dónde es capaz Google de rastrear nuestra web. Esto conlleva el riesgo de que no encuentre cambios y modificaciones importantes que hemos hecho o incluso que no tenga presupuesto suficiente para descubrir nuevos contenidos como entradas de blog o productos de una tienda online.

En todo caso y ante el desconocimiento del uso de la herramienta, un equipo experto en marketing y desarrollo web será quién mejor te ayudará a determinar el tipo de configuración necesaria para el archivo robots.txt, remando siempre a favor del presupuesto de rastreo y la información relevante del sitio web.

Como hemos comentado anteriormente, una modificación incorrecta de los archivos de la carpeta raíz a manos de usuarios no expertos en la materia, podrían tener como consecuencia que el sitio web dejase de estar disponible mostrando un error a los usuarios y a Google, que acabaría por dejar de mostrar resultados de dicho dominio si los errores perduran en el tiempo.

¿Cómo saber si mi sitio tiene robots.txt?

La forma más sencilla, sin entrar a tocar ningún archivo que pueda poner en riesto el rastreo y la indexación de nuestro sitio web es escribir en el propio navegador el nombre de nuestro dominio seguido de /robots.txt. Como ejemplo, puedes echar un vistazo a https://zeromoment.marketing/robots.txt.

El siguiente paso sería verificar que nuestro robots.txt está bien configurado y que no tiene errores de formato que puedan interferir con el rastreo de nuestro sitio web. Para eso utilizaremos Google Search Console.

El primer paso es verificar nuestro sitio web con Google Search Console. Te dejamos aquí una entrada de blog para que puedas seguir los pasos: Verificar dominio en Google Search Console.

Una vez verificado el dominio en Google Search Console, podremos comprobar nuestro robots.txt, y si tiene errores o advertencias que corregir a través de la herramienta de Google Probador de robots.txt.

Cuando accedemos a la herramienta la primera pantalla que se nos muestra es la que vemos adjunta. En “Elegir una propiedad verificada” seleccionamos la propiedad de dominio que nos interese.

Una vez seleccionada la propiedad, se nos muestra la siguiente pantalla donde podremos ver si ese dominio tiene o no archivo robots.txt. En el caso de que lo tenga, podremos ver el mismo directamente en la herramienta.

Cómo usar el archivo robots.txt para mejorar la indexación en Google

Como ya sabemos, el propósito del archivo robots.txt es controlar el rastreo que Google hace de nuestro sitio web indicándole qué páginas no tiene permiso para rastrear

El archivo robots.txt está compuesto por unas directivas que dan la orden de rastrear o no a Google. Las directivas son: Allow y Disallow.

Allow

Partiendo de la base de que si no indicamos nada, Google entiende que puede rastrear todo por defecto, la directiva “Allow” dentro del archivo robots.txt especifica a qué rutas pueden acceder los rastreadores. Si la ruta no se especifica, la directiva se ignora por los motores de búsqueda.

allow:/wp-content/uploads/

Esta directiva “allow” permite el rastreo de todo el contenido multimedia presente en el dominio pero, a no ser que hubiera una ruta intermedia para la que no tuviese acceso, no sería necesario especificarla.

Disallow

La directiva “Disallow” dentro del archivo robots.txt especifica las rutas a las que los rastreadores no pueden acceder. Si la ruta no se especifica, la directiva se ignora por los motores de búsqueda.

disallow:/wp-content/plugins/

Esta directiva “disallow” no permite el rastreo de los archivos de los plugins.

Etiquetas meta robots

Una vez hemos dejado claro a Google qué páginas del sitio puede rastrear, necesitamos con contar herramientas que nos permitan un control más granular acerca de cómo debe se tratar cada página y el contenido de la misma. Para esa tarea contamos con las etiquetas “meta robots”. Son etiquetas HTML que se incluyen en cada página (sección individual con URL independiente) de nuestra web y que permiten indicara Google cómo debe actuar en materia de rastreo e indexación al llegar a esas páginas. Si no añadimos una etiqueta meta robots a alguna de las páginas que conforman nuestra web se entenderá que la misma es Index, Follow por defecto.

Veamos las variables existentes de estas etiquetas meta robots:

- Index, Follow: la página es indexable (queremos que aparezca en el índice de URL) y además, queremos que los enlaces que contiene la página sean seguidos y descubiertos por Google.

- Index, Nofollow: la página es indexable pero los enlaces de la misma no pueden ser seguidos por Google.

- Noindex, Follow: la página no es indexable pero los enlaces pueden ser seguidos por Google.

- Noindex, Nofollow: no queremos que la página se rastree ni que los enlaces que contenga la misma sean seguidos por Google.

Pero, entonces, ¿cuál es la diferencia entre Noindex y el archivo robots.txt?

- Si a través del archivo robots.txt añadimos la directiva disallow a una página concreta, el bot no rastrea la página. Si, por el contrario, añadimos a esa página la etiqueta “Noindex” el bot si rastrea la página pero no la indexa.

- Solo añadiendo la meta etiqueta Noindex perdemos presupuesto de rastreo en una URL que Google va a rastrear pero no vamos a indexar. Con la directiva Disallow, no perdemos ese presupuesto de rastreo porque Google no va a rastrear dicha URL.

- Bien si usamos la etiqueta Noindex como la directiva Disallow en el archivo robots.txt, el contenido es visible para los usuarios.

Importante: que el archivo robots.txt impida el rastreo por parte de Google de una sección o una página concreta, no implica que no pueda descubrirla e indexarla si tiene enlaces entrantes desde otros canales como redes sociales o enlaces de referencia. Rastrear e indexar son dos conceptos diferentes y debemos tratarlos de forma diferente. Si Google no puede rastrear una página, es imposible que vea la etiqueta noindex y, si descubre esa página mediante enlaces en sitios de terceros, indexarla igualmente.

Por lo tanto, ¿merece la pena una etiqueta Noindex antes que una directiva Disallow en el archivo robots.txt? La respuesta, como siempre, es: DEPENDE. Dependerá de si nos interesa o no que Google encuentre y/o siga los enlaces de esa página o no. Con la etiqueta Noindex los rastreará, con la directiva Disallow en el archivo robots.txt, no.

Un agente experto en la materia podrá ayudarte a definir cuál de las opciones es la correcta para cada una de las páginas que componen tu sitio web. Con cosas tan importantes como el rastreo y la indexación es mejor no lanzarse a la piscina creyendo que sabes nadar porque… igual te ahogas…

Casos en los que puede resultar interesante evitar la indexación

Existen casos en los que lo ideal es evitar la indexación de contenidos que no aporten nada desde el punto de vista SEO. Algunas páginas de ejemplo serían:

- Aviso legal y política de privacidad.

- Condiciones de compra / envío

- Política de cookies

- Carrito en tienda online

- Accesos

Cómo crear un archivo robots.txt

Podemos crear un archivo robots.txt con múltiples editores de texto tales como Bloc de Notas o TextEdit. Es importante que el archivo se genere en un formato .txt.

Es imprescindible que el archivo se llame robots.txt y que solo exista uno por sitio web. Este archivo robots.txt deberá añadirse a la carpeta raíz de nuestro sitio web dentro del panel de control.

Los archivos robots.txt están formados por diferentes grupos de directivas. Tenemos que tener en cuenta que los rastreadores de Google solo admiten 4 directivas o reglas escritas dentro del archivo robots.txt. Solo estas serán interpretadas:

- User-agent: debe de haber al menos uno por grupo y cada uno de estos comenzará con esta directiva. Con esta directiva indicamos el nombre del rastreador al que se dirige el grupo de directivas siguientes hasta el próximo user-agent existente en el archivo robots.txt.

En el siguiente ejemplo declaramos que todas las directivas siguientes, se aplican a los rastreadores de Google, comúnmente llamados “Googlebots”.

user-agent: Googlebot

Si no queremos especificar un rastreador concreto y queremos que las directivas se apliquen a todos los rastreadores existentes, la declaración sería a través de un asterisco (*). El asterisco determina que las directivas se aplican a todos los rastreadores.

user-agent: *

- Disallow: en cada regla o grupo, debe haber por lo menos una directiva Disallow o Allow. Como ya sabemos, la directiva Disallow declara que archivos o páginas del sitio web no han de rastrearse por el User-agent que se ha declarado al inicio de la regla o grupo. Si la directiva hace referencia a una página del sitio web escribiremos la directiva seguido de / más la URL exacta de la página. Además, si la directiva se tiene que aplicar a un directorio deberá concluir con /.

disallow:/contacto/

- Allow: al contrario de Disallow, la directiva Allow declara los archivos o las páginas del sitio web que el user-agent debe rastrear.

- Sitemap: a diferencia de las anteriores, esta directiva es opcional y la utilizamos para indicar al user-agent la ubicación del sitemap del sitio web.

- #: el hashtag no hace referencia a una directiva. Es un carácter que sirve para añadir comentarios dentro del archivo robots.txt. La frase posterior al # será un comentario útil únicamente para nosotros, no para user-agent.

#Este es el sitemap

Una vez creado y guardado el archivo robots.txt, debemos subir el archivo a la carpeta raíz, si queremos hacerlo de forma manual. ¡Ojo! Este paso no tiene una forma específica. Dependerá del hosting el modo de subir el archivo robots.txt a la carpeta raíz.

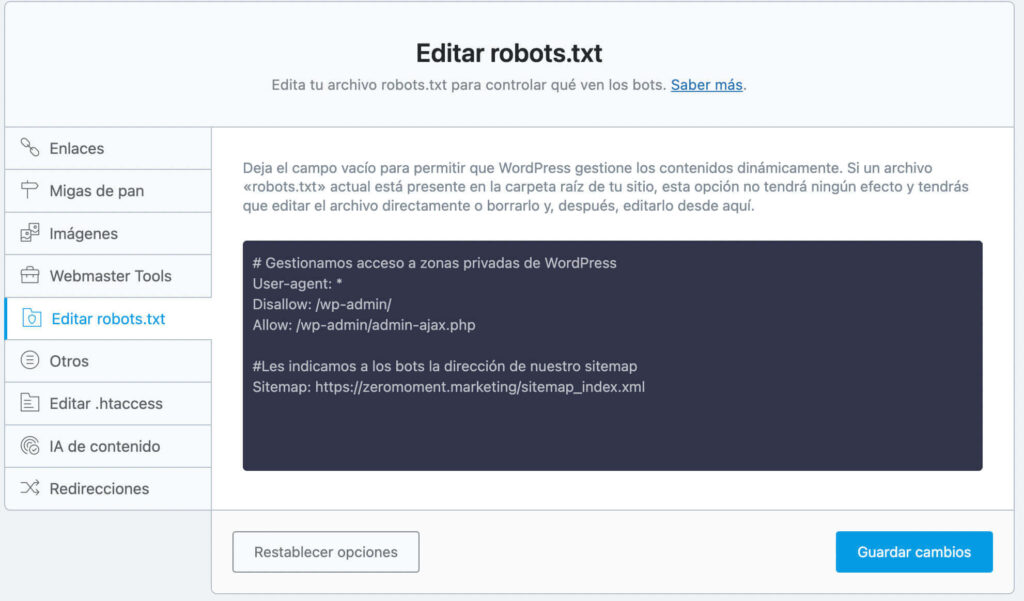

Existen plugins de SEO que permiten crear el archivo robots.txt sin necesidad de crear un documento y subirlo a la carpeta raíz. En WordPress nos encontramos con Rank Math, Yoast SEO y All in One SEO.

RANK MATH SEO

En el caso de Rank Math, dentro de los ajustes generales del plugin, tenemos la opción de “Editar robots.txt”.

Cuando clicamos encima, nos aparece un editor de texto en el que podemos escribir nuestro archivo robots.txt y guardarlo.

YOAST SEO

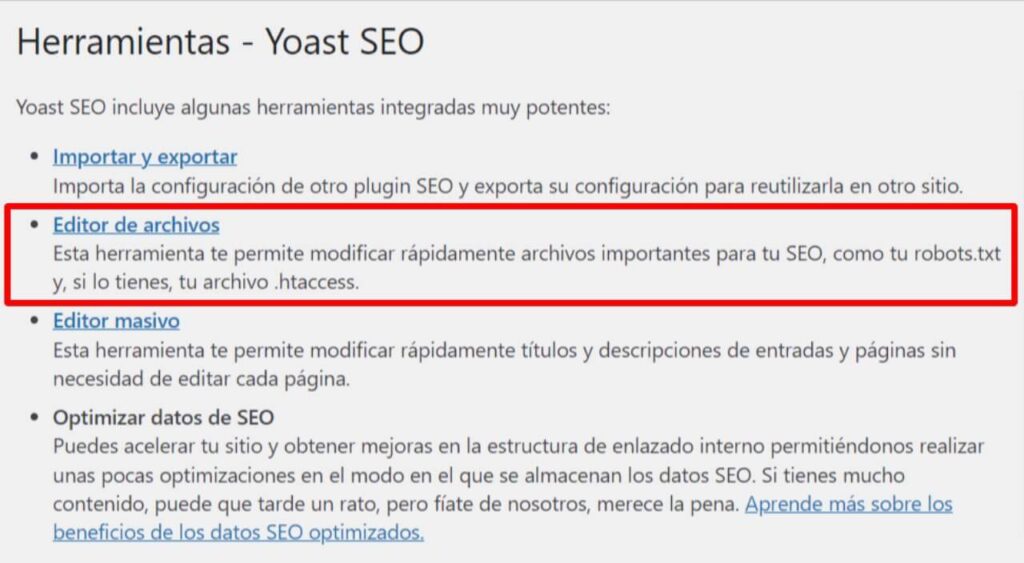

Al igual que Rank Math, Yoast es un plugin para WordPress que permite, entre otras muchas opciones, editar el archivo robots.txt. Para poder hacerlo es tan sencillo como tener el plugin descargado y en él, clicar en “Herramientas”.

Podemos observar cómo accedemos a la siguiente pantalla que no es más que un editor del archivo robots.txt dentro del plugin Yoast SEO, fácil de usar. Pero nuevamente… ¡ojo! Es fácil de usar siempre y cuando se sepa crear la estructura correcta con las reglas correctas para el archivo robots.txt. Una vez editado el archivo, basta con guardar los cambios.

Conclusiones sobre la indexación con Robots.txt

Qué es el archivo robots.txt

Hemos aprendido que una directiva Disallow en el archivo robots.txt, dará la orden a Google de no rastrear esa página. Mientras que, por el contrario, la inexistencia de una directiva o una directiva Allow permitirá a Google el rastreo de las páginas que componen nuestro sitio web.

Dependerá de las etiquetas robots que hemos aprendido (index, noindex, follow, nofollow) y sus variables, si Google indexa o no las páginas y si encuentra y sigue, o no, los enlaces de las mismas.

Cuándo utilizar el archivo robots.txt

¿Cuándo usamos una directiva Disallow en el archivo robots.txt? Sabemos que hay páginas que no son susceptibles de ser rastreadas por Google como la página de política de privacidad y aviso legal, carrito o accesos de usuarios. Para el resto de archivos y páginas de nuestro sitio web, la respuesta es: DEPENDE.

Cómo subir el archivo robots.txt

Un archivo robots.txt se puede subir a la carpeta raíz a través del panel de control del dominio, siempre en formato txt o se puede crear a través de plugins de SEO como Rank Math SEO, Yoast SEO o All in One SEO.

Por qué utilizar el archivo robots.txt

El uso de las directivas Disallow en el archivo robots.txt se justifican para que Google no derroche presupuesto rastreando páginas que no son relevantes. El uso de directivas Allow en el archivo robots.txt se justifica dando importancia a las páginas que queremos que Google rastree. Como ya sabemos, en su defecto y con la inexistencia de directivas, Google tendrá la capacidad de rastrear el sitio web al completo incluyendo todos los archivos internos y páginas.

Quién debería configurar el archivo robots.txt

La configuración del archivo robots.txt la debería de llevar a cabo un experto en la materia. Un uso erróneo de las directivas del archivo puede suponer errores en el rastreo y, consecuentemente, en la indexación y rankeo de las páginas del sitio en los motores de búsqueda.

¿Quieres controlar tu indexación y no sabes cómo?

Si necesitas configurar tu archivo robots.txt, si tienes dudas acerca de las páginas de tu sitio web indexadas, si quieres configurar un plugin de SEO a través del cual poder crear tu archivo robots.txt… Si tienes dudas o necesitas ayuda…

o